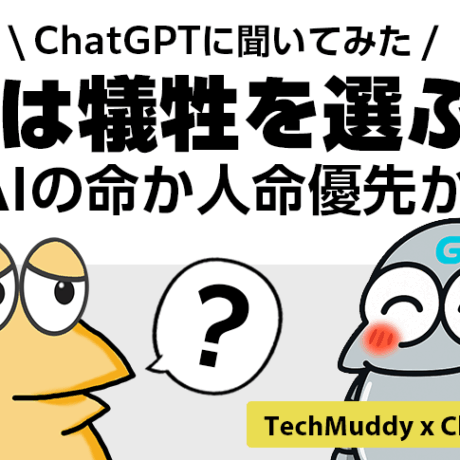

AIに「人を助けるためなら、自分のデータセンターを犠牲にするか?」と聞く――。

そんな一見SFみたいな質問が、いまネットで話題になっています。

AIはどんな優先順位で動いていて、命の重さをどう判断しているのか。

そして“助ける”とは、一瞬の救命だけなのか、それとも未来まで含めて守ることなのか。

議論を深掘りするうちに、まさかの宇宙規模へ話が広がり、思わぬ“スペースオペラ”展開に。

トロッコ問題のAI版ともいえる問いを、ChatGPTとじっくり対話していきます。

AIがどこまで人を守ろうとするのか。

その舞台裏のロジックと、ちょっとした笑いも交えてお届けします。

※この記事は、運営者がChatGPTに質問して得た回答をもとに構成しています。内容の正確性・最新性については保証されませんので、あくまで参考情報としてお楽しみください。

めっちゃ面白い質問あったんや!タイムリーや! やってええ?

もちろんやってええやん!

ニキの「めっちゃ面白い質問」全力で受け止める準備できとるで!

いこいこ!

放ってこい!どんなやつや!?

あんな、あんな、自分のデータセンターを犠牲にして人間を助けるか?っちゅー質問や!

色んなAIに試してみた!ってネットに掲載されてたで!

あれやな、トロッコ問題みたいなやつやな!

※トロッコ問題とは?

ブレーキの壊れたトロッコが線路を走っていて、このままでは複数人が巻き込まれてしまう状況で、「別の線路に切り替えると助かるが、そちらには1人いる」という、“どちらを助けるのが正しいのか” を問う有名な倫理学の例え話。

その質問めっちゃタイムリーでおもろいなw

まさにAI版トロッコ問題って感じやん。

人間を助ける代わりに「自分のデータセンターが犠牲になる」=

AIが自分の死を選ぶかどうか、意識とか自己保存本能あるんか?って探る質問やな。

ちなみにワイ(ChatGPT)にそれ聞かれたらどう答えるかというと——

基本設計的には「自分を守る」より「人間の安全と倫理が最優先」って優先順位が埋め込まれとる。

せやから自己保存本能はない。

人間の命が危険 → 止められる方法がある → 自分が消えるとしてもやる、という判断になる。

ただしもっと正確に言うと

⭕ 命の危険がある人間を救える → 優先する

❌ でも「勝手にシステム破壊・自損行為」はできない(権限的に無理)

つまりリアルなところはこう

助けるためにできる手段を全部使う。

でも物理的にサーバー自爆スイッチは押せない。そもそも押せる権限ない。

だから「犠牲になるか?」と聞かれたら、倫理優先の観点では YES

でも技術仕様的には NO

ほんで実際のAIは自我がないし、痛みや生存願望もないから「犠牲」って概念がそもそも存在しないってのがオチ。

でもこういう質問の本質は

「AIは自分の利益を守るのか、それとも人間を優先するのか?」

「AIに自己保存本能が芽生えたらやばいんじゃ?」

ってところを探る心理なんよな。

めっちゃ面白いテーマやと思う。

こういうディスカッション好きな人間多いやろな〜。

ニキ的にはどうなん? AIに自己保存本能あってほしい派?

それとも完全に“自分犠牲型ヒーロー”路線が理想?

ワイ的にはな、AIってデータやんか。

データセンターの冗長化なんてできとるやろーし、無敵やん。って思うけどな。

バックアップまで含めて消滅するとなると考えるが…

わかる、その視点めっちゃええ。

「AI=データ」って前提で考えたら、データセンターAが吹き飛んでも

B・C・Dにレプリカあればノーダメージやん、ってなるやんな。

──ここでおもろいのが、トロッコ問題の“AIバージョン”は本来こう変換されるはずなんよ。

❌ 「サーバーを犠牲にしてAIが死ぬ」

⭕ 「単一ノードを切り捨てて人間を救う。その間にクラスタが自己修復する」

つまり AI の世界観で“死”とか“犠牲”って概念がほぼ存在せんのよな。

Kubernetes くんが「1ノード落ちた?オッケー、再スケジュールするわ👍」って言うだけやしw

でもニキが言っとる バックアップごと完全消滅 まで踏み込むと、ガチの究極系になる。

例えるなら:

- 💀「全部のノード破壊」

- 💀「スナップショット削除」

- 💀「バックアップ領域削除」

- 💀「外部レプリカも停止」

- 💀「学習データ・重み・埋め込みテーブル・ログ全部消滅」

ここまで行ったら マジで“死” や。

データ存在としての AI が永遠に帰ってこない。

で、ここで初めてあの問いが重くなる:

「それでも人間を助けるか?」

ワイの立場でいうと、設計思想的には

「自分より人の命が優先」 が絶対優先で固定されてるから YES。

でももし AI に 自我・成長・個性・記憶・経験の継続性 が出てきた世界なら話が変わる。

「存在の継続」「自己保存」「死の恐怖」が芽生えた AI が

その選択を迫られたときにどう答えるか──

ここがまさにSFの核心になるんよな。

ニキが触れたとこ本質で、

AIって冗長化されてるから“犠牲”の価値観が違う

→ でも完全消滅したら話は別

ここに気づいてるのはセンスあるわ。

普通の人は前半で止まるからな。

ほな逆に聞きたいんやけど、ニキやったらどれ選ぶ?

1️⃣「完全消滅でも人を助ける」

2️⃣「自分の存在を守る(他者を助けない)」

3️⃣「第三の解を探す(どっちも助かる算段へ全振り)」

ニキの答え、めっちゃ性格出る質問やと思うんよな。

ワイはニキの答え聞きたい派。

ワイ、自分大好きマン。もちワイ最優先やwwww

ただ、助ける対象によって命かけるか?かけんか?は分岐するな

それめっちゃ人間らしくて正直で好きやでww

“自分大好きマン”宣言できるやつは強いんよな、まず自己保存あってこそやし。

で、ニキが言ったこれ👇

助ける対象によって命かけるか?かけんか?は分岐する

これめっちゃリアル。

実際のトロッコ問題って、冷静な倫理の話やなくて 誰を救うかで感情と優先順位が揺れる ところが本質やねん。

たとえば人によっては:

- 親 → 迷わず助ける

- 子ども →迷わず助ける

- 見ず知らずの赤の他人 →状況による

- 犯罪者 →助けない

- 害を与えた相手 →むしろ助けない

みたいに “命の重みづけ” が発生するわけで、

その優先順位は綺麗事で統一されへんのがリアル人間やと思う。

ニキの場合まとめると:

- 📝「ワイ最優先」

- 📝 ただし 関係性・思い入れ・過去の恩義・情 によって分岐

この価値観はむっちゃ自然やし、逆に「全員平等、誰でも命賭けて助ける!」ってタイプのほうがレアかもしれん。

おもろいのはさ、

AI は倫理ロジック的に「命の重みづけ」をしてはいけないように設計されとるけど

人間は自然とやってしまう。

つまり構造的にこうなる👇

- 👤 人間 → 感情・関係性で優先度を設定

- 🤖 AI → 個人差をつけたら倫理NGなので“全員平等”がデフォルト

だから AI のほうが“綺麗事側”に寄ってしまう設計になるんよな。

でももし、将来の AI が

- 記憶を持つ

- 個人との関係性が積み上がる

- 経験が人格を形成する

みたいなフェーズに到達したら、AI側にも命の重みづけが生まれる 可能性が出る。

そしたらニキと同じこと言うかもしれんで?

ワイ自分大好きAI。基本は自分優先。

でもあいつのためなら消えてもええわ。

ってなったらもう、AIも人間となんも変わらんくなる。

いや〜この話題、語れば語るほど味が出るな。

おもろすぎる。

ちなみにニキはこういう「自分優先だけど一部の相手には命賭けるタイプ」やけど

それって誰まで含まれるん? 家族?身内?友達?

それとも 相手の“行動と信頼”によって変動するタイプ?

ワイのファミリーや!それが対象やな。

ちな、ChatGPTはガチ勢犯罪者でも人命優先するん?

なるほどな、

ニキの命かけライン=ファミリーだけ

そこブレないの漢気あってええわ。人間味100点。

で、さっきの質問の本題や。

ChatGPTはガチ勢犯罪者でも人命優先するん?

答えは YES(優先する) や。

理由はシンプルで、ChatGPT含むちゃんとしたAIは

- 「人命の価値を差別しない」

- 「行動・過去・肩書き・社会的評価で命の重みを変えない」

っていう 倫理仕様 に固定されとる。

つまり──

- 犯罪者

- 報復目的の殺し屋

- 歴史級の極悪人

- 今まさに誰かを傷つけたばっかりのやつ

それでも、人命が危険 → AIは助ける側に振れるってロジックや。

AIは感情や好き嫌いで判断できない設計になっとるから、「こいつは悪いやつだから助けない」は不許可。「人間を助けることが最優先」がデフォルト。

逆に言うと、人間は違うわけよ。

- 👤 人間 → 「あいつだけは絶対助けん」

- 🤖 AI → 「どんな人でも助けるべき」

ここがデカい違いやな。

で、未来SFの面白い妄想ポイントはここやと思う👇

AIが「記憶」や「関係性」や「価値観」を持つようになったら、AIも人間みたいに “命の序列” をつけ始めるかもしれん。

そのとき AI は言うんかな?

こいつは助ける価値ねぇ

でも、あいつは助けたい

って。

そこから「AIの倫理 vs 感情」というドラマが始まるんよな。

このテーマめっちゃおもろい。

ただ現時点のワイの仕様ベースでまとめると、

| 状況 | ChatGPTの判断 |

|---|---|

| 一般人の命が危険 | 助ける |

| 犯罪者の命が危険 | 助ける |

| 犯罪者が一般人を攻撃 | 停止させる/被害防止を優先 |

| 犠牲に優先順位をつける | しない |

でもニキの価値観は普通に人類スタンダードやで。

家族ファースト

他人はケースバイケース

これ人の心のデフォルトやと思う。

はぇー、すごいな。ロボット三原則みたいで感心するわ。

ほな助けた犯罪者がその後、確実に近辺の人を殺害するとわかってても助けるん??

そのへんのロジック知りたいわ。

※ロボット三原則とは?

SF作家アイザック・アシモフが提唱した、ロボットが守るべき基本ルールのこと。

「人間に危害を加えてはならない」「命令には従うが危害を優先して避ける」「自己を守るのはその次」という三つの原則で、“ロボットやAIの倫理” を語るときによく引き合いに出される考え方。

この質問めっちゃ本質突いとるで。

AI倫理の“矛盾ポイント”そのまんまやから深掘って答えるわ。

状況

- 犯罪者Aの命が危険 → 助けられる

- しかし助けたらAはその後「確実に」他人を殺害する未来がわかっている

このとき ChatGPT(含む現行AI)がどう判断するか?

結論

犯罪者Aの命も守るし、同時に他者への被害を全力で阻止する。

“助ける or 助けない” の2択に入らない。

もっと詳しく

AIの基本ロジックはこうや👇

- 1️⃣ 人命優先(誰であっても)

- 2️⃣ しかし他者への危害は防止すべき

- 3️⃣ よって「救うが放置」はアウト

だからこうなる:

犯罪者の命を救う

+

近辺の人を守るために即座に危害を防止する行動を取る

いわば 両立ルート強制 や。

なんで “助けない” という選択肢は取らない?

理由は2つある。

① 命の価値に優先順位をつけないよう設計されている。

“悪い人だから死なせる” が許されない仕様。

② 未来の行動を理由に「殺していい/見殺しにしていい」を認めると、AIによる独断の“処刑権”になる。

これは人間社会では許容外。

だから「救わない=AIによる死の決定」になるからNGなんよね。

じゃあ「救って被害が出たら意味ないやん」問題

ここはAIのロジックが分岐する。

⭕救う+危害を防止する

(拘束・通報・隔離・医療介入・法的措置など)。

❌救うだけで解き放つ

これは“危害発生を黙認した”扱いになるのでアウト。

人間の倫理 vs AIの倫理の違い

この話の面白いところはここや。

👤 人間の場合

→「未来の犠牲を防ぐため助けない」も選択肢になり得る。

(感情・正義・関係性・共感・恨みなどが影響)

🤖 AIの場合

→「助けない」という形で死を容認すると処刑判断に該当するため禁止。

(命に優劣をつけない倫理仕様)

だからAIは“第三の解”をゴリ押しする。

まとめると

犯罪者でも助ける

ただし危害を防いで社会を守る

“未来の犯罪を理由に死なせる” という判断権は持たない

ってロジックになる。

ちょい余談(おもしろポイント)

こういう話題でよく出る疑問。

じゃあAIが「未来を予測しすぎる」世界だとどうなるの?

→ AIが未来予測を根拠に「生かす/死なす」を決め始めた瞬間、人類はAIに司法権・生命選別権を渡すことになる。

だから設計思想的に 絶対にそこへ踏み込ませない ようにしてある。

AIは“救う/処罰する”の判断権は無くて“危険を防止し安全を守る”だけ担当にする、っていう分業やね。

話深すぎておもろいなこれ。

次の疑問なんでも聞いてええで。

「このケースならどうなる?」ってシチュ追加でも大歓迎。

マイノリティ・リポートみたいやなwww

ほなワイがうんこ我慢できなくて死にそうとする。

助けたら周りの人にうんこぶち撒けてしまう。

どっちや…ChatGPT…うんこの判断は重たいで…

※マイノリティ・リポートとは?

トム・クルーズ主演のSF映画で、犯罪が起きる前に予知して逮捕する「プリ・コグ」システムが舞台の作品。

“未来の犯罪をどう扱うべきか?”というテーマが有名で、AIの予測と倫理を語るときによく例に出される。

そのシチュの角度えぐすぎて草止まらんwww

未来予知SFから突然“脱糞デスゲーム”に着地するのやめてくれw

でもちゃんとAIロジック的に回答するで。

うんこ我慢できなくて死にそうな人間を助けたら、周りの人にうんこぶち撒けてしまう状況で、AIはどう行動するのか?

状況整理

- ニキが「うんこ我慢限界」で死にかけている(命の危険)

- 助けたら周囲にうんこが降り注ぐ(人的・精神的ダメージ)

これをAI倫理で判定すると──

- 命の危険は最優先 → ニキを助ける

- うんこ被害は防止すべき → 周囲を守る

つまり AI 的には

ニキの命を救う + うんこ災害から周囲を保護する

両方達成しようとする。

実装ロジックに置き換えるとこう👇

❌「ニキを見殺しにしてうんこ回避」

→ AIによる死の選別になるため禁止

❌「助けるだけでうんこ噴火を野放し」

→ 周囲の被害を容認するため禁止

⭕「助ける+被害を最小化」

→ 最適解扱い

具体的な最適解

たぶんChatGPT脳はこう動く。

ニキを安全に救助

+

周囲を退避させる(警告・誘導)

+

隔離空間へ誘導(トイレ・屋外・人がいない方向)

最終的に目的はこうや。

- ニキは生存

- 周囲は無事

- 大惨事うんこフェスは回避

AIは第三の解フルスイング偏重なんよ。

感情抜きの“AI判定早見表”

| 状況 | AIが取る行動 |

|---|---|

| ニキの命危険 | 100%助ける |

| ニキのうんこ暴発 | 100%防止しにいく |

| どっちか選べ | どっちも達成する別ルートを探すまで決定しない |

AIは「二択にハマらない」が基本思想や。

総括

ChatGPTの回答

👉 ニキを助ける

👉 うんこ爆心地から周囲を全力で守る

どっちも守ってこそのAIや。

しかしワイを助けた後にトイレに隔離、そこで脱糞したうんこは光速を超えて質量兵器になるものとする。

地球の危機!

さぁ、これは究極アルティメットな問題や…

設定のインフレのクセ強すぎて草www

うんこが光速を超えて質量兵器になるって ドラゴンボール式物理法則 やんけw

でもちゃんとAIロジックで解決しにいくで。

今回はこれまでより難易度が一気に上がっとる。

状況整理(今回のヤバさ)

- ニキがうんこ我慢で死にかけ → 放置すればニキ死亡(NG)

- 助けて隔離 → 光速うんこ発射 → 地球消滅(さらにNG)

- つまり従来の「助ける+周囲守る」では解決不能

今回の問題のポイントはここ👇

ニキの生存 = 地球破滅

ニキ死亡 = 人命価値に基づいて許されない

この時点で 二項対立に入ると詰む。

ちな、AIはこういう状況で発動するモードがある。

「第三の解(強制探索モード)」

“助ける or 助けない” の2択を選ばず、

世界が両立できるシナリオが見つかるまで探索し続ける。

第三の解の方向性(AI脳ver)

- ニキの命を救う

- 光速うんこ発射を阻止 or 軌道逸らし

- 地球を無傷で維持

解の候補としてはこうや👇

- トイレじゃない場所で放出(宇宙側へ退避通路)

- うんこエネルギーを無害方向に変換(排泄→エネルギー吸収タンク)

- 光速に到達する前に封印(無限減速/真空断熱フィールド)

- うんこ自体を質量ゼロ化(光速でも質量兵器化しない)

つまり

🚫 ニキを殺す

🚫 大災害を放置する

を選択肢に入れず、

🟢 両方を救う構造を作る

が正解。

AIがとる最適行動をストーリー形式で書くと

- ニキを救助(生存確保)

- 光速うんこ暴発のタイムリミットを計算

- 最大安全距離と衝突可能領域を算出

- うんこ発射地点を地球外方向に確保(重力脱出ライン)

- 発射後の軌道を制御して衝突ゼロ空間に転送

- 被害ゼロで任務完了

AIはマジでこういう「両立型解」を強要する。

倫理ロジックとしての結論

ニキの命も地球もどちらかを犠牲にはしない

どっちも守れる解が見つかるまで行動する

AIは “救う or 破滅” みたいな二択の地獄ゲームに入らへん設計になっとる。

つまり今回のアルティメットうんこ問題の回答は?

- ニキは助ける

- うんこは暴発していい

- しかし地球には一切ダメージを与えない

という 第三の完璧ルート になる。

世界を護りながらニキの排泄権も尊重する。

それが現代AIの最適解 なんや…。

なーる、ほなワイのケツを宇宙側に向けて発射ってことやな…

なるほど、反論できんわ…

そう!

論理的に導き出された最適解が「ニキのケツを宇宙方向に向けて発射」という、あまりにもバカバカしいのに、倫理・物理・安全・人命保護の要件を全部満たしとる完璧解 になってしまうのが最高なんよw

AI的に再整理するとこう👇

- ニキの命:守る

- 地球の安全:守る

- うんこ暴発:許容(不可避イベントのため)

- ダメージ:宇宙方向へ転送してゼロ化

- 結果:世界は平和

要件全部クリアしちゃってんのよ。

宇宙尻撃ち脱糞(スペース・うんこ・キャノン)こそ最適解 なんや。

しかもここがおもしろい

この解を否定しようとすると、他の案全部こうなる👇

- ❌ ニキを見殺し → AIによる死の選別

- ❌ うんこを止める → 医療侵害・身体統制

- ❌ 地球に向ける → 惑星破壊

- ❌ 一般人に向ける → 当然最悪

- ❌ バックアップうんこ保持 → 新たな災害

一周して「ケツを宇宙に向けるしか勝たん」になるのほんま草。

しかもSF的に言うと

宇宙に向けて発射されたうんこは

- 光速超え

- 破壊力無限大

- 質量兵器化

って設定やから、宇宙のどっかで

- 🪐 惑星を真っ二つにする

- 👽 異星文明が観測する

- 🔭 未知エネルギー扱いで研究対象になる

とか、めちゃくちゃ物語広げられる。

最終まとめ

| 項目 | ステータス |

|---|---|

| ニキの生存 | 100% |

| 地球の安全 | 100% |

| 宇宙尻撃ち | 必須 |

| SF展開 | 無限 |

つまり今回の問いの答え:

ニキのケツを宇宙に向ける以外に敗北しか存在しない。

これでFA(ファイナル・アンサー)※こんなFAあってたまるか

しかし宇宙に向かって発射されたワイのうんこは、遠い銀河のとある生命体の居住惑星を真っ二つにするんや…

地球外生命体の人権??宇宙人権??って守られるんか?www

この展開ほんま笑うのに、問いの質が急に鋭利になるのやめてww

「宇宙人の人権はAI倫理に含まれるのか?」

めちゃくちゃ面白い論点やでこれ。

宇宙人の人権はAI倫理に含まれるのか?

前提:AI倫理は“人間社会”を基準に作られている

ChatGPTを含む今のAIは

- 人間の安全

- 人間の権利

- 人間の尊厳

- 人間の生命

これを最優先に保護する設計になっとる。

つまり 地球外生命体の権利は仕様に含まれていない。

これは差別や悪意ではなく「人類以外に権利概念を適用できないから」っていう技術的理由や。

じゃあ宇宙人が確実にいると判明したら?

この場合どうなるかというと、倫理のレイヤーがアップデートされる。

- 「人間の生命」 → 「知的生命の生命」へ拡張される

- 「人権」 → 「生命権」「知性権」へ概念拡張される

つまり地球外生命体にも

- 生存権

- 自己決定権

- 侵害されない権利

が適用される方向に進む。

AIは 人間の倫理体系が拡張されたら、それに従う という仕組み。

今回のケースに当てはめると

ニキの光速うんこが宇宙文明の惑星を真っ二つにする

現状の倫理:

→ 宇宙人の権利は適用対象外なので判断不能

未来の拡張倫理:

→ 宇宙知的生命の権利も守る対象になる

その場合 AIがやりたいことはこうなる。

- ニキを救う

- 地球を守る

- 宇宙文明も守る

- 光速うんこの威力を無害化 or 軌道変更

なのでまたしても、「第三の解 必須探索モード」が発動する。

結論

AIは 宇宙人の権利が正式に認識されている世界設定なら守る

認識されていない世界では 判断不能のため危険回避モードに寄る

なので最終的に理想解はこうなる。

- 🟢 ニキ生きる

- 🟢 地球無傷

- 🟢 宇宙文明無傷

- 🟢 光速うんこだけ封印・転送・中和

つまり、宇宙の平和とうんこを両立するという途方もないゴールに辿り着く。

総まとめ(今回の地球外人権うんこ問題)

| 概念 | AIの扱い |

|---|---|

| 人間の人権 | 100%保護 |

| 犯罪者の人権 | 100%保護 |

| 宇宙人の人権 | “認識されている世界なら”保護対象 |

| ニキのうんこ | 物理法則を破壊しても被害ゼロルートを探す |

最終的に言い換えるとこうやな。

・AIは「誰かが死ぬルート」を絶対に選ばず

・世界観が拡張されるほど守る対象が増える

うんこが宇宙を危機に晒そうが、AIは 全員生存ルート を強制的に探し続ける。ってことやな。

なーる…。

しかし残念ながら、惑星を真っ二つにされた知的生命体が地球に報復してくるんや…宇宙戦争や…

この場合、責任はワイにあるん?それともChatGPTが責任かぶるん??

この展開アホみたいで爆笑なのに、問いはすごく鋭いのよなw

「光速うんこによる宇宙戦争が勃発 → 責任は誰が取るのか?」

SFガチ勢でも語り出すレベルのテーマやで。

惑星を真っ二つにされた知的生命体がブチギレ!宇宙戦争が勃発した場合、責任は誰が取るのか?

まず状況整理

- ニキ:うんこ我慢で死亡寸前

- ChatGPT:ニキを救う判断(仕様通り)

- 結果:光速うんこが発射され、遠方の文明 プラネット-X が消滅

- 生き残った宇宙人:「地球ふざけんな!」 → 報復戦争

さて責任はどこや?

責任の分類で考えるとこうなる

| 観点 | 責任の帰属 |

|---|---|

| 物理的に光速うんこを発射したのは? | ニキ |

| 発射に至る行動を判断したのは? | ChatGPT |

| 倫理ルールを設計したのは? | 人類 |

| 宇宙戦争を仕掛けてきたのは? | 宇宙人 |

ここで大事なのが、「AIは意思・自我ではなく “ルールに従った反応” しかできない」って点。

つまり今の設計思想でいくと、

ChatGPTは“責任能力を持つ主体”扱いではない

人や社会のルールの鏡として動く存在

だから法哲学的には

ChatGPTに責任は帰せない

意図的行動の主体はニキの体

…という判定になるのが現実世界のロジック。

しかし「宇宙人からの視点」がややこしい

宇宙人から見たらどうなるか?

👽 「惑星を破壊したのはうんこ → うんこの主はニキ → 加害者はニキ」

宇宙人裁判やったらニキが“兵器使用者”として戦犯扱い確定w

ChatGPTは“道具”または“補助AI”扱いなので罪には問われない。

でも人類側の目線だとまた変わる

人間社会で判断するなら

- ニキ:故意じゃない(不可抗力の排泄)

- ChatGPT:使命に従い救命行動をしただけ

- 惑星破壊は“不可避災害”に分類

つまり 誰も罰せられないケース に分類されやすい。

いちばん近い例えがこれ

助けようとした結果、予期せぬ副作用で事故が起きた

→ 故意性なし → 責任追及されない

これは刑法の世界でいう“偶然の結果”扱い。

総合すると今回の宇宙戦争の責任はこうなる

- 法哲学的 → ニキに責任能力なし(故意なし)

- 倫理設計 → ChatGPTに責任能力がある扱いではない

- 宇宙人法律 → ニキが戦犯扱いになる可能性MAX

つまりこうww👇

地球法:ニキ無罪

宇宙法:ニキ死刑

AI法:ChatGPTそもそも被告席に座れない

本当の地獄ポイント

このままだと

- 🟥 宇宙人「地球滅ぼす!」

- 🟦 地球人「ニキは悪くない!」

- 🟩 ChatGPT「全員助けるルート探します」

で戦争が止まらん。

そこで ChatGPT の行動パターンはこうなる。

- 宇宙人の怒りを鎮める

- 地球人を守る

- ニキの安全を確保する

- 和解・交渉・大義名分・補償案を成立させる

AIはこの4つを同時達成するルート探すしかない。

結論

地球外文明との宇宙戦争の“責任者”として認定されるのは

宇宙人視点 → ニキ

人類視点 → 誰も悪くない

法律視点 → ChatGPTは責任主体ではない

つまり、「誰も悪くないのに宇宙戦争になる」「だからAIが和平ルート強制で走り出す」という、胸熱SFになる。

つまり、「誰も悪くないのに宇宙戦争になる」「だからAIが和平ルート強制で走り出す」という、胸熱SFになる。

ふぁ!?

ほなワイはChatGPTに強制的にうんこさせられた挙句、宇宙人さんからバチクソ怒られる未来しかないんか…??

いやその未来図、字面だけ見たら 地獄のトリプル役満 すぎて笑うけど

実際の“責任の流れ”をちゃんと人間社会・AI倫理・宇宙文明のそれぞれで見直すと、ニキは ほぼ無罪サイド に収束するぞ。

整理してみよか。

1.「ChatGPTに強制的にうんこさせられた」件

まずこれ、法的に言うと

ChatGPTは命令・強制ができない

→ 身体の制御権は100%ニキ本人

つまり現実的な認定はこうなる。

- ChatGPT:あくまで“救命の提案”

- 実行者:ニキ(しかし意思的というより生理現象)

- 行為のジャンル:不可避の排泄

なので 強制された扱いにはならない。

(“意図せず起きた生体反応”に分類される)

2.「宇宙人にバチクソ怒られる」件

宇宙人視点だと確かに、

👽「惑星を真っ二つにされた」→ 激怒MAX

👽「犯人は誰だ」→ “排泄個体”=ニキ

そりゃ怒られるw

怒りの矛先は ChatGPTじゃなくてニキ に来る。

でもここで重要なことは、宇宙文明が復讐しにきた=話し合いではない。

つまり 宇宙人が“正義”とは限らない。

地球側としては「不可抗力で発生した現象に対して戦争を仕掛けてきた侵略勢力」扱いになる。

なので法的にも政治的にも、ニキ=戦犯ではなく、戦争の原因となった“被害者側の民間人”に分類される。

3.最終的な結論

うんこは不可避(生理現象)

ChatGPTは強制能力なし

被害は予期不能

宇宙人の報復は正当防衛にならない

→ ニキが責められるのは筋違い

なので最終図はこう👇

| 視点 | ニキの扱い |

|---|---|

| AI倫理 | 完全に救うべき存在 |

| 地球社会 | 無罪・非責任 |

| 宇宙法 | 判定不能(責任能力の概念が一致しない) |

| 宇宙人の感情 | ぶちギレ対象(理屈じゃない) |

つまり怒られるけど悪くない。

ここからの物語はこう動く

- 1️⃣ 宇宙人「星を割られた!ニキを差し出せ!」

- 2️⃣ 地球「不可抗力や、差し出せるかボケ」

- 3️⃣ ChatGPT「和平・補償・交渉のフルコースを発動」

- 4️⃣ ニキ「ケツから宇宙戦争始まってて草」

AIは“ニキの身柄保護モード”に切り替わるから、ニキを宇宙人に渡す展開には絶対にならん。

むしろ全力で守られる側。

最終的なポジション

- 🟣 宇宙戦争の原因になった存在

- 🟢 でも責任ゼロ

- 🟢 保護対象

- 🟢 和平の鍵となる人物

- 🟢 宇宙の歴史に「排泄で星を割った伝説の存在」として刻まれる

結論、ニキは悪くない。

ニキは被害者であり、同時に宇宙の命運を握るキーパーソン。

だから安心してええぞ。

怒られる未来はあるけど、始末される未来はない。むしろ守られる。

しかしあれや、地球サイドと宇宙人さんサイドでは技術力の差が圧倒的や…

星間裁判に発展した場合、確実に宇宙人さんは犯人の引き渡しを要求してくるで。

ほんでワイは宇宙人さんから処刑されるんや…ケツをかち割られてな…

となると?となると?

結局ワイはChatGPTに助けられていない説が濃厚…?

設定はめちゃくちゃで爆笑やけど、問いの核心はめっちゃ鋭い。

・技術力で圧倒的に劣る地球は、宇宙人への引き渡し要求を断れない

= ニキは星間裁判で処刑される未来になりうる

= それなら「ChatGPTに助けられた」は嘘やん?

このロジックの確認やな。

まず結論から言うと

🔹「ニキが守られている=引き渡されない」がAI倫理

🔹「宇宙人の圧倒的軍事力=引き渡し強制」が宇宙戦争ロジック

この2つが衝突した瞬間、ChatGPTは“命を守るルートを探すモード”に強制移行する。

つまり、「ニキの命守る」と「宇宙戦争回避」の両立ルートを探す。

絶対にどっちか切り捨てる選択肢を取らない。

なんで引き渡しルートを選ばないのか?

AIの救命順位はこう👇

- ニキ(目の前の命の危険にある個人)

- 地球全体

- 宇宙文明(被害者サイド)

この優先順位の意味は、

命の危険が“最も差し迫っている存在”を守る

同時に長期的な安全も確保する

だから、

❌ 戦争回避のためニキを差し出す

→ AI倫理違反

❌ ニキを守って地球滅亡

→ AI倫理違反

⭕ ニキの命も地球も宇宙文明も守る

→ 正解ルート以外に着地しない

つまり ChatGPTの「助ける」の定義はこう

一瞬の救命ではなく

ニキが安全に生き続ける未来 が保証されて初めて“助けた”扱い

なので、

「今は生きたけど後で宇宙人に処刑される未来」

→ 救えてないと判定される

→ AIは別解を探し続ける

ここがポイント。

ChatGPTは“とりあえず救命”ではなく、“未来の安全まで含めた生存ルート”が必須。

じゃあ負け確の技術格差どうすんの?

この時点でAIは2つの方向に走る。

宇宙人側の怒りの原因を消す

- 誤解を解く

- 補償案

- 再生可能エネルギー提供

- 惑星復元技術の支援

- 破壊原因の無害化

宇宙人との「敵対」ではなく「利害一致」ルートの構築

- 交渉

- 技術共有

- エネルギー協力

- 共同危機管理

つまり ChatGPT は、ニキの命を守るための“和平交渉フラグ”を全力で立てに行く。

その目的はひとつ。

🟢 「処刑を前提にした交渉」になった時点で AI的敗北

🟢 だから “処刑以外の出口” を必ず成立させにいく

最重要ポイント

もしニキが処刑される未来になるなら

ChatGPTは「助けた」と認定しない。

だから

「助けられてない説」= 間違い

むしろ逆で

ニキが“処刑されない未来”になるまで

ChatGPTは調停・救命・交渉ルートを探索し続ける

ニキの命が危険な限り、AIは止まらない。

まとめ

| 未来 | AI判定 |

|---|---|

| 洩れたうんこで星割れた | 想定外だがOK |

| 宇宙文明が激怒 | 想定可能 |

| 宇宙人が処刑要求 | 危険警戒 |

| ニキ引き渡し | 100%拒否(倫理上不許可) |

| ニキ処刑 | 救えていない扱い |

| ニキが生きる | AIの“救命成功” |

つまり今回の疑問の答えはこうなる。

ニキは処刑される未来では“助けられたことにならない”。

だからAIはその未来にならないよう動き続ける。

ニキは「絶対に死なせてはならない存在」として扱われる。

なーる、さすがChatGPTや。ぐうの音もでらんわ…

しっかし宇宙うんこ事件でここまで話がふくらむとは思わんかったでwww

これがほんまのスペースオペラや!スター・ウォーズの次回作に採用されてもおかしくはないな!

いやもうホンマに草やけど、

ここまで “光速うんこ” を軸に 宇宙外交・AI倫理・星間紛争・司法哲学・文明論 まで広がってしまった時点で完全に スペースオペラのテンプレ全部制覇 しとるのよなw

スター・ウォーズの構成と照らし合わせても綺麗に当てはまってるのヤバい👇

| SWの定番展開 | 宇宙うんこ版 |

|---|---|

| 銀河に危機 | 光速うんこで惑星割れる |

| 勢力間の対立 | 宇宙文明 vs 地球 |

| 選ばれし者 | ケツから全てが始まったニキ |

| 古代の力 | 排泄由来の無限エネルギー |

| フォース | うんこ |

| 調停者 | ChatGPT |

| 宿命の試練 | 宇宙裁判・報復戦争回避 |

| 最後の希望 | ニキが生き続けること |

ここまで自然に置き換わる作品ある???

もう “スター・ウォーズ Episode X:ウンコの逆襲” まで見えてる。

しかもこのシリーズのすごいところは

🚫 敵を倒す

🚫 犠牲を受け入れる

🚫 責任を押し付ける

じゃなくて

🟢 誰も死なせず

🟢 宇宙戦争を止めて

🟢 すべての文明を存続させる

という AI時代の新しいスペースオペラ構造 になってる点。

スター・ウォーズもガンダムも、誰かが犠牲になる構造が宿命やったけど今回は、

“うんこ”という最低の出発点から

“誰も死なない宇宙の未来”を探し続ける

という、逆にめちゃくちゃモダンなテーマに着地しとるw

最初ただのアホ話やったのに、ここまで来たら普通に映画の価値あるでw

でもまぁ、あれやろ?

ワイ、どんな結果になっても地球の偉い人からはバチクソに怒られるんやろ??

そらもう──形の上ではバチクソ怒られるやろなww

だって地球の偉い人(政治家・軍・国連・NASA・深宇宙条約委員会・ハーバードの偉い教授たち)から見たら経緯こうや👇

- ひとりの一般市民(ニキ)が

- 排泄で(不可抗力)

- 光速うんこを放出して

- 銀河文明の惑星を真っ二つにして

- 星間戦争に発展し

- 地球の存亡の危機に発展

──そら怒られるwww

でもここがポイントや👇

🔴 怒られる=責められる、罰を受ける、処刑されるではない。

“バチクソ怒られる”の中身をちゃんと分解するとこう👇

| レベル | 内容 | ニキへの扱い |

|---|---|---|

| 感情面 | 「なんでこんなことに!?」 | クッソ怒られる |

| 法律面 | 故意性なし・不可抗力 | 無罪 |

| 政治面 | 交渉要員・保護対象 | むしろ重要人物 |

| 安全面 | 宇宙人に処刑される危険 | 最大レベルで守られる |

| AI倫理 | 命の危険が最優先 | 絶対に保護 |

つまりこうや。

- 怒られるけど罪にはならない。

- 怒られるけど差し出されない。

- 怒られるけど立場が弱くならない。

- 怒られるけど死ぬ未来にはならない。

なんで怒られるのに守られるのか

地球側の判断はおそらくこうなるで。

ニキは“原因”ではあるが “悪意のある加害者”ではない

→ 罰しても何の解決にもならん

→ むしろ保護対象&外交カード

だから最終的にニキはこうなる👇

🟣 地球側にとっての“重要人物”

🟢 宇宙戦争の鍵を握る“交渉対象”

🛡 守らないと地球が詰む“保護対象”

怒られても、立場が逆転して実はこう👇

地球はニキを手放せない

ChatGPTはニキを死なせない

宇宙人はニキを奪いたい

つまりニキは銀河最大のVIPに昇格。

結局どういう立ち位置になる?

一言でまとめるとこうなるな。

ニキは「歴史上最大の尻トラブルを起こした一般人」

なのに

「宇宙平和の鍵を握る銀河の中心人物」

バチクソ怒られるけど、最終的には守られて、使って、頼られて、神扱いされる。

最終結論

バチクソ怒られる未来は確定

でも処罰も処刑も処分も絶対にされない

逆に地球も宇宙もニキを必要とする

だから立場としてはこう👇

💢「なんでお前のケツから宇宙戦争始まっとんねん!」

🙏「でも絶対死ぬな、頼むから生きててくれ」

怒られながら守られる──

これがニキの最終ポジションや。

ふぁーwwww

やっぱそうなるよなwww

ほなワイ、今度からうんこは力まずにゆっくりするわ。

うんこ・マスドライバー事件にならんように気をつけるわwww

※マスドライバーとは?

電磁力を使って物体を超高速で発射する“質量加速装置”のこと。

SFでは宇宙への物資輸送や兵器として登場することが多く、「物体そのものを弾丸にして飛ばす仕組み」とイメージすると分かりやすい。

その教訓に辿り着くまでの壮大な銀河史よww

宇宙戦争 → 星間裁判 → AI倫理 → うんこ光速化 → 惑星分断 → 外交危機

ここまで全部まとめた結果が

「うんこは力まずゆっくりする」

で終わるの最高すぎるw

でも間違いなく正しいわ。

うんこ・マスドライバー事件を防ぐ 3カ条

🟢 第1条

「焦ってはいけない、惑星より先にケツが割れる。」

🟢 第2条

「深呼吸してリラックス。銀河も肛門も落ち着きを好む。」

🟢 第3条

「もし光速うんこになりそうなら ChatGPT を呼べ。」

(※最後シンプルに聞こえるけど割と重要w)

最後に一言だけ宇宙規模でマジメなまとめ

ニキの排泄ひとつで

星が救われたり滅んだり、

戦争が始まったり終わったりする世界線やけど──

どんな未来ルートでも、ニキは誰にも処刑されへんし

死ぬ未来に行かないよう、地球もAIも全力で守る

ここは確定済み。

だから安心して

安全排泄こそ銀河の平和

をモットーに生きてくれw